Héberger son IA avec Ollama

🎓 Étudiant en BTS SIO (option SISR) – passionné par les systèmes, l’automatisation et les scripts utiles. 💻 Je partage ici des tutoriels, notes techniques et astuces IT, basés sur mon apprentissage et mes expérimentations.

Payer un abonnement tous les mois juste pour taper la discute avec une IA... ça va un moment. Surtout qu'on peut faire tourner des modèles ultra-puissants directement chez soi, et gratuitement en plus. L'avantage évident, c'est que vos données restent 100 % privées.

Honnêtement, Ollama rend le truc ridiculement simple. Le seul passage qui m'a vraiment pris la tête au début, bizarrement, c'est le réseau. Juste le fait d'arriver à s'y connecter depuis un autre appareil.

Voilà comment je fais.

L'installation de base (sur le PC)

Si vous êtes sur votre ordi principal (Windows ou Mac), c'est la méthode rapide. Vous chopez la version pour votre OS sur la page de téléchargement d'Ollama. Suivant, suivant, terminer... le grand classique.

Sauf que voilà. Par défaut, Ollama est complètement parano. Il refuse purement et simplement les connexions qui ne viennent pas de l'ordinateur lui-même. Vous essayez de l'utiliser depuis votre téléphone ? Mur invisible.

Le truc pour régler ça (et c'est le détail bête que j'oublie systématiquement), c'est de lui dire d'accepter le réseau local. Il faut juste créer une variable d'environnement sur votre système : OLLAMA_HOST=0.0.0.0. C'est tout.

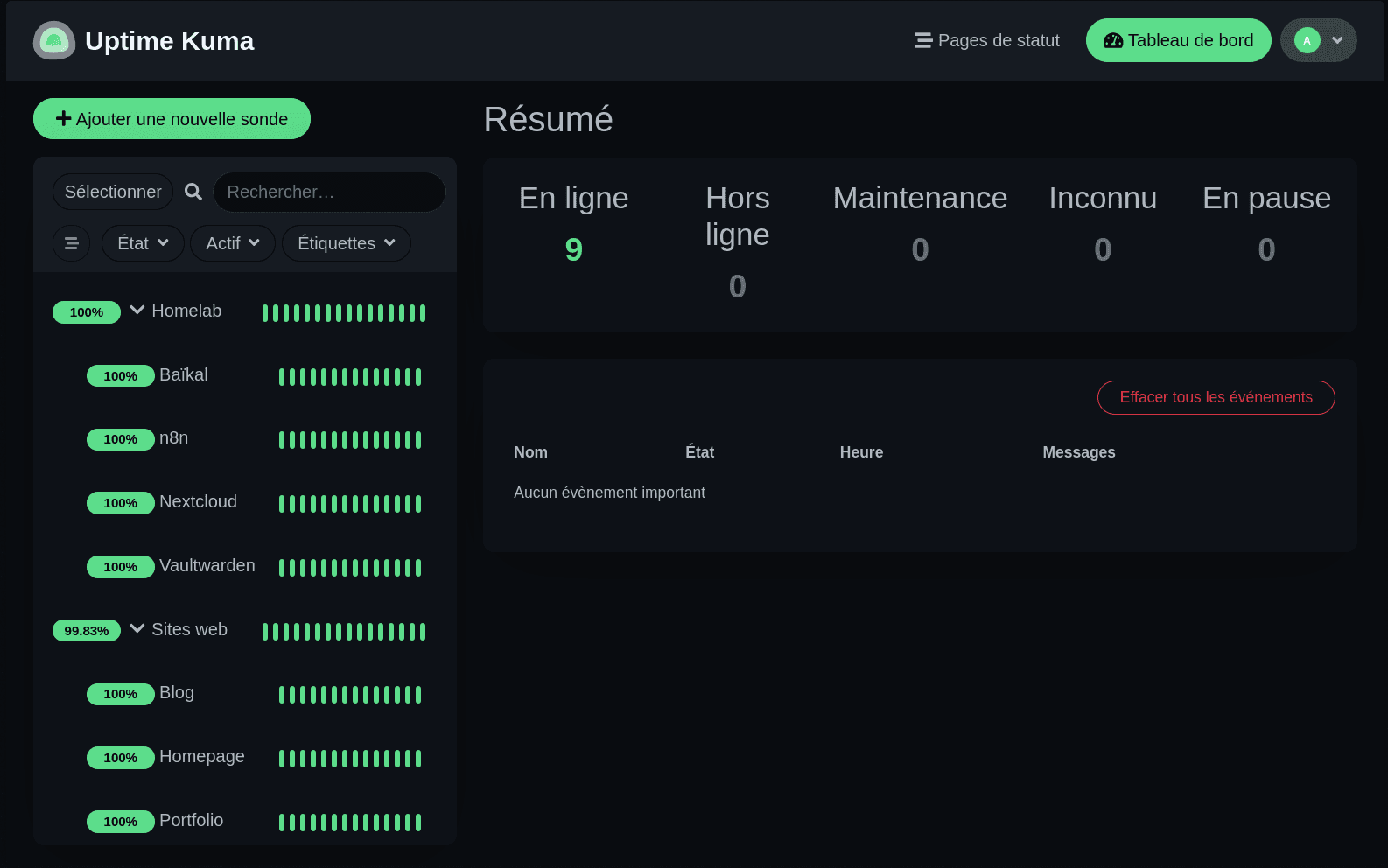

Ma préférence : passer par Docker

Perso, je fais tout tourner via Docker sur mon serveur. Déjà parce que c'est beaucoup plus propre, mais surtout parce que ça règle ce problème de réseau d'un seul coup. En publiant le port du conteneur, l'IA est exposée automatiquement sur le réseau local. Pas de variable à configurer.

Plus, les commandes docker run à rallonge qu'on perd dans l'historique du terminal, très peu pour moi. Je me suis crée un petit fichier docker-compose.yml et on n'en parle plus.

C'est super basique (j'ai laissé les lignes pour l'accélération matérielle commentées au cas où votre matériel est doté d'un GPU Nvidia) :

services:

ollama:

image: ollama/ollama:latest

container_name: ollama

ports:

- "11434:11434"

volumes:

- ./ollama_data:/root/.ollama

restart: unless-stopped

# Décommentez les lignes ci-dessous si vous avez un GPU Nvidia

# deploy:

# resources:

# reservations:

# devices:

# - driver: nvidia

# count: 1

# capabilities: [gpu]

Un coup de docker-compose up -d dans le dossier. Et c'est réglé. Le serveur tourne en fond.

Et pour s'en servir ?

Peu importe l'installation, il faut lui donner un "cerveau". Un petit ollama run llama3 dans le terminal, on laisse le téléchargement se faire.

La vraie question c'est : on fait quoi après ? Parce que discuter avec une IA dans une fenêtre noire sur le PC, c'est sympa cinq minutes, mais l'idéal c'est quand même d'y accéder depuis le canapé.

C'est exactement pour ça que j'ai développé FolliA.

C'est un petit client Android open-source que j'ai voulu ultra-léger. L'idée est bête : vous prenez votre téléphone, vous checkez que vous êtes sur le même réseau que le PC (en Wi-Fi, ou via un VPN si vous n'êtes pas chez vous), on rentre l'IP de la machine dans les paramètres... et boom.

Votre propre assistant privé, directement dans votre poche.

Pour les intéressé, cliquez ici pour accéder au repo github. (N'hésitez pas à mettre une étoile).